A/B-Testing 2026: Der Guide für bessere Entscheidungen

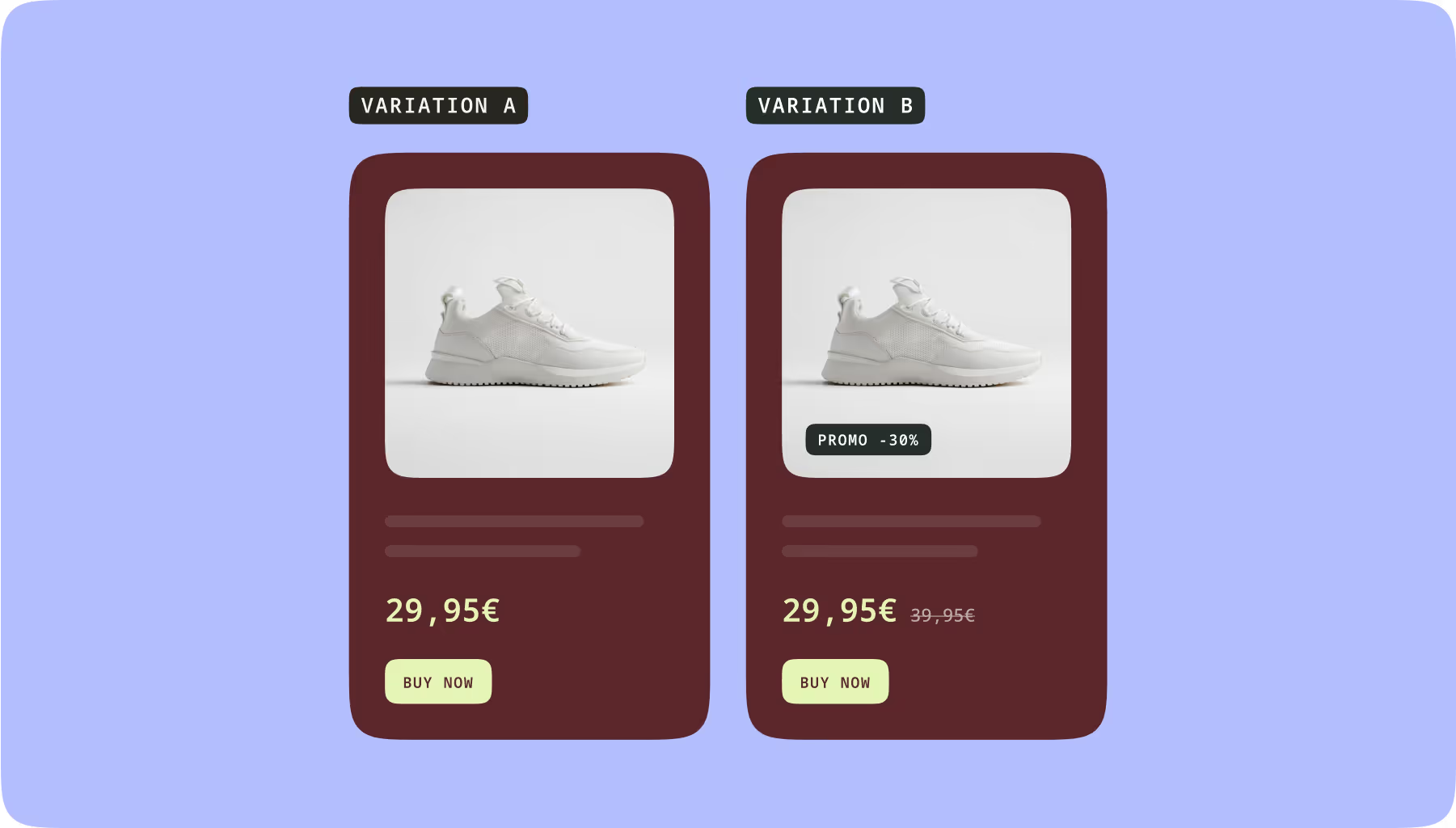

A/B-Testing bezeichnet den Vergleich von zwei Varianten einer Webseite oder App, um zu ermitteln, welche Version besser performt. Es ist ein zentrales Werkzeug für Marketer, Entwickler:innen, Produktmanager:innen und CRO-Spezialist:innen, um User Experience und Conversion Rates zu optimieren.

Was ist A/B-Testing?

A/B-Testing ist ein Verfahren der Experimentation, mit dem sich feststellen lässt, welche von zwei oder mehr Varianten – etwa einer Seite oder eines Seitenelements – basierend auf definierten Kennzahlen die beste Performance erzielt.

Im Kern zeigt A/B-Testing auf Basis statistischer Auswertung, welche Variante für die Zielgruppe besser funktioniert.

So funktioniert ein A/B-Test:

- Aufteilung des Traffics in zwei oder mehr gleich große, zufällige Gruppen

- Ausspielung unterschiedlicher Varianten über einen definierten Zeitraum

- Vergleich der Performance anhand von KPIs wie Conversions oder Umsatz

- Analyse der Ergebnisse zur Bewertung einer dauerhaften Umsetzung

Welche Vorteile bietet A/B-Testing?

A/B-Testing bietet zahlreiche Vorteile für Unternehmen. Die wichtigsten lassen sich in fünf zentrale Bereiche gliedern:

Steigerung der Conversions

Durch das Testen verschiedener Varianten lassen sich Websites kontinuierlich optimieren und Conversion Rates nachhaltig verbessern.

Höheres Engagement

Relevantere Experiences steigern die Interaktion und fördern langfristige Kundenbindung.

Besseres Verständnis der Nutzer:innen

A/B-Testing zeigt, wie einzelne Elemente das Verhalten beeinflussen und liefert wertvolle Insights zu Bedürfnissen und Erwartungen.

Datenbasierte Entscheidungen

Hypothesen werden anhand messbarer Ergebnisse validiert, wodurch Risiken reduziert und fundierte Entscheidungen ermöglicht werden.

Effizienter Einsatz von Ressourcen

Erkenntnisse aus Experimentation helfen, Budgets und Maßnahmen gezielt auf wirkungsvolle Ansätze auszurichten.

Mit A/B-Testing lassen sich zentrale Fragen zuverlässig beantworten:

- Welche Elemente steigern Conversions oder beeinflussen Verhalten?

- Wo bestehen Schwächen im Conversion Funnel?

- Lohnt sich die Einführung neuer Features?

- Welche Formularlänge ist effektiver?

- Welche Inhalte erzeugen mehr Reichweite?

Wie verschiedene Teams A/B-Testing nutzen

A/B-Testing ist besonders wertvoll aufgrund seiner Flexibilität. Unterschiedliche Teams können mit gut konzipierten Tests relevante Erkenntnisse gewinnen und datenbasierte Entscheidungen treffen.

Marketingteams

Marketingteams setzen A/B-Testing ein, um die Performance ihrer Kampagnen über verschiedene Kanäle hinweg zu optimieren. Beispielsweise können unterschiedliche Call-to-Actions auf Landingpages getestet oder verschiedene Experiences verglichen werden, um KPIs gezielt zu verbessern.

Produktteams

Für Produktteams ist A/B-Testing ein wichtiges Instrument zur Steigerung von Engagement und Retention. Typische Anwendungsfälle sind das Testen von Onboarding-Prozessen oder neuer Features im Rahmen von Feature Experimentation.

Growth- und Experimentation-Teams

Diese Teams nutzen A/B-Testing, um Customer Journeys zu analysieren und zu optimieren.

Beispielsweise werden Landingpage-Varianten auf Registrierungen oder Produktseiten auf Warenkorbabbrüche hin getestet.

Arten von A/B-Testing

Es gibt verschiedene Formen von A/B-Testing, die heute in Teams eingesetzt werden. Eine der wichtigsten ist das Split Testing.

Split Testing

Beim Split Testing wird der Traffic auf unterschiedliche URLs verteilt, ohne dass Nutzer:innen dies bemerken.

Der Begriff wird teilweise synonym zu A/B-Testing verwendet, unterscheidet sich jedoch: Split Tests sind komplexer und eignen sich besonders für den Vergleich kompletter Experiences, statt einzelner Varianten auf derselben Seite.

Multivariate Testing (MVT)

Multivariate Testing (MVT) ist eine Methode im A/B-Testing, bei der mehrere Varianten eines oder mehrerer Elemente gleichzeitig getestet werden.

So lassen sich unterschiedliche Kombinationen – etwa von Headlines, Beschreibungen und Produktvideos – parallel evaluieren. Ziel ist es, die leistungsstärkste Kombination zu identifizieren.

.avif)

Ein wesentlicher Nachteil von Multivariate Testing ist der hohe Bedarf an Traffic, um statistisch belastbare Ergebnisse zu erzielen.

Vor dem Start eines solchen Tests sollte daher sichergestellt werden, dass ausreichend Nutzer:innen vorhanden sind, um repräsentative Resultate zu generieren.

A/A-Testing

A/A-Tests vergleichen zwei identische Varianten eines Elements. Der Traffic wird dabei gleichmäßig aufgeteilt, wobei beide Gruppen dieselbe Version sehen.

A/A-Testing dient dazu, zu überprüfen, ob Conversion Rates in beiden Gruppen vergleichbar sind und ob das Testing-Setup korrekt funktioniert. Zudem hilft es, technische Fehler oder Ausreißer zu identifizieren und erhöht so die Verlässlichkeit von Experimenten.

Multi-armed Bandit Testing (Dynamic Traffic Allocation)

Beim Multi-armed Bandit Testing – auch Dynamic Traffic Allocation genannt – wird der Traffic automatisch und schrittweise durch einen Algorithmus auf die besser performende Variante umgeleitet.

Feature Testing

Feature Testing, auch Feature Experimentation genannt, umfasst die Entwicklung und den Vergleich mehrerer Feature-Varianten innerhalb der Codebasis.

Während die Implementierung häufig durch Developer erfolgt, ermöglichen No-Code- oder Low-Code-Tools auch nicht-technischen Rollen wie Produktmanager:innen, eigenständig Experimente umzusetzen.

Die Steuerung erfolgt über Feature Flags, die Nutzer:innen gezielt unterschiedlichen Code-Versionen zuweisen.

Feature Testing liegt in der Komplexität zwischen Client-side- und Server-side-Tests und bietet hohe Flexibilität, da nahezu alle Elemente der Codebasis getestet werden können.

Als Wachstumstreiber gewinnt Feature Experimentation zunehmend an Bedeutung: Laut dem Experimentation-led Growth Report 2025 investieren über 50 % der High-Performance-Unternehmen gezielt in diesen Bereich.

A/B-Testing und statistische Modelle

A/B-Testing basiert auf statistischen Methoden. Für aussagekräftige Ergebnisse ist kein tiefgehendes mathematisches Wissen erforderlich, grundlegende Statistikkenntnisse tragen jedoch zur Qualität von Tests bei.

A/B-Testing-Lösungen nutzen in der Regel zwei zentrale statistische Ansätze, die je nach Anwendungsfall unterschiedlich geeignet sind.

Frequentistische Methode

Die frequentistische Methode liefert ein Konfidenzniveau, das die Zuverlässigkeit der Ergebnisse misst. Ein Konfidenzniveau von 95 % bedeutet beispielsweise, dass die Ergebnisse mit hoher Wahrscheinlichkeit korrekt sind.

Ein Nachteil ist der sogenannte „Fixed Horizon“: Aussagekräftige Ergebnisse liegen erst am Ende des Tests vor.

Bayesianische Methode

Die Bayesianische Methode stellt bereits während des Tests Wahrscheinlichkeiten zur Verfügung. Trends können somit früh erkannt und interpretiert werden.

Die Herausforderung liegt in der Interpretation der Konfidenzintervalle während des Tests. Mit jeder zusätzlichen Conversion steigt die Aussagekraft der Ergebnisse.

Frequentistisch oder Bayesianisch – welche Methode passt?

Die Wahl zwischen frequentistischer und Bayesianischer Methode hängt davon ab, wie viele Erkenntnisse aus vergleichbaren Experimenten bereits vorliegen und wie ähnlich das aktuelle Setup ist.

Bei ähnlichen Rahmenbedingungen – etwa gleicher Zielgruppe, vergleichbarem Zeitraum und identischem Feature – kann die Bayesianische Methode schneller zu belastbaren Ergebnissen führen.

Bei neuen Features oder abweichenden Zielgruppen sind vorhandene Daten oft weniger relevant. In solchen Fällen ist eine frequentistische Analyse die geeignetere Ausgangsbasis.

Server-side vs. Client-side A/B-Testing

A/B-Tests können grundsätzlich auf zwei Ebenen durchgeführt werden: serverseitig oder clientseitig.

Client-side A/B-Testing

Erfordert weniger technisches Know-how und eignet sich daher besonders für Marketingteams, Growth-Teams und den Einstieg in Experimentation. Tests lassen sich schnell umsetzen, wodurch Ergebnisse zügig verfügbar sind und Engpässe vermieden werden. Rund 51 % der High-Performance-Unternehmen investieren stark in clientseitiges Testing.

Server-side A/B-Testing

Erfordert mehr technische Ressourcen und Entwicklungsaufwand, bietet dafür jedoch eine höhere Flexibilität, Skalierbarkeit und tiefere Eingriffsmöglichkeiten in die Anwendung.

Die Wahl des passenden Ansatzes hängt von mehreren Faktoren ab: Unternehmensstruktur, verfügbare Ressourcen, Entwicklungsprozesse sowie der Komplexität der Experimente.

Client-side A/B-Testing

Beim clientseitigen Testing wird der Code direkt im Browser der Nutzer:innen angepasst. Die Seite wird vom Server geladen, während ein Skript im Browser entscheidet, welche Variante angezeigt wird – unabhängig vom verwendeten Browser.

Vorteile:

- Schneller Einstieg mit geringem technischem Aufwand

- Umsetzung von Frontend-Tests und Personalisierung über visuelle Editoren (WYSIWYG)

- Keine Backend- oder Developer-Ressourcen erforderlich

- Unterstützung komplexer Experimente wie Multivariate Testing und seitenübergreifender Personalisierung

- Einfache Zusammenarbeit mit Agenturen und CRO-Spezialist:innen

- Nutzung von Browser-Daten für Tests

Nachteile:

- Eingeschränkte Möglichkeiten für tiefergehende Experimentation

- Keine Tests von Backend-Logik, Features oder Algorithmen

- Nicht geeignet für Mobile-App-Testing

- Risiko von Flicker-Effekten bei fehlerhafter Implementierung

- Mögliche Auswirkungen auf Ladezeiten

- Einschränkungen durch Datenschutzmaßnahmen wie ITP

- Einschränkungen bei der Nutzung in Single-Page Applications (SPA), abhängig von der Implementierung

Server-side A/B-Testing

Beim serverseitigen Testing werden Varianten im Backend erzeugt und ausgeliefert – nicht im Browser der Nutzer:innen.

Vorteile:

- Höhere Kontrolle über Experimente und Testelemente

- Erweiterte Möglichkeiten, inklusive Backend-Logik und Datenbankzugriff

- Kein Flicker-Effekt

- Unterstützung von Mobile-App-Experimentation

- Keine Auswirkungen auf Ladezeiten oder Performance

- Unabhängiger von Einschränkungen durch clientseitige Datenschutzmaßnahmen

Nachteile:

- Erfordert Developer-Ressourcen für Konzeption und Umsetzung von Tests, was bei begrenzten Kapazitäten die Geschwindigkeit von Experimentation einschränken kann

- Integration und Pflege von Drittanbietersystemen für Targeting und Datensynchronisation liegen in der Verantwortung der Entwicklung

- Wartung von SDKs oder Abhängigkeit von entsprechenden Plattformlösungen

- Kaum auslagerbar, da tiefes Verständnis der Systemarchitektur erforderlich ist

- Eingeschränkte Nutzung von In-Session-Daten wie Browserinformationen für Targeting

Der Umstieg von Client-side auf Server-side Testing ist strategisch sinnvoll, erfordert jedoch stärkere technische Einbindung

Der hybride Ansatz im Testing: Die Vorteile von Client-side und Server-side kombinieren

Ein hybrider Ansatz ermöglicht es, die Vorteile von Client-side und Server-side A/B-Testing zu vereinen. So lassen sich clientseitige Funktionen auch bei serverseitigen Tests nutzen.

Hybrid Experimentation kombiniert JavaScript (Client-side) und SDKs (Server-side), um Experimente effizienter und zugänglicher für verschiedene Teams zu gestalten. Server-side Tests können durchgeführt werden, ohne stark von Developer-Ressourcen abhängig zu sein.

Vorteile:

- Arbeiten in einer zentralen Plattform mit vertrauten Tools für alle Teams

- Verbesserte Steuerung von Tracking und Reporting

- Geringere Abhängigkeit von Entwickler:innen für Skripte und Integrationen

- Höhere Effizienz und bessere teamübergreifende Zusammenarbeit

Kameleoon bietet eine hybride Experimentation-Plattform, die serverseitige Tests mit clientseitigen Funktionen kombiniert und sich nahtlos in bestehende Tech-Stacks integriert.

Was lässt sich mit A/B-Testing testen?

Grundsätzlich kann nahezu jeder Aspekt einer Website, App oder Customer Journey getestet werden. Entscheidend ist weniger das „Was“ als das „Wie“.

Je nach Anwendungsfall eignen sich unterschiedliche Ansätze – einige Tests lassen sich besser clientseitig umsetzen, andere erfordern serverseitige Testing-Methoden.

Client-side Testing: Anwendungsbeispiele

Client-side Testing eignet sich besonders für Elemente, die direkt im Browser dargestellt werden, darunter:

- Seitentitel

- Banner

- Textbereiche

- Call-to-Actions

- Bilder

- Testimonials

- Links

- Produktkennzeichnungen

Server-side Testing: Anwendungsbeispiele

Grundsätzlich lassen sich alle clientseitigen Tests auch serverseitig durchführen – allerdings mit höherem Entwicklungsaufwand oder in Kombination mit einem hybriden Ansatz.

Server-side Testing eignet sich besonders für Bereiche, die im Browser nicht zugänglich sind oder tief in der Backend-Infrastruktur liegen.

Typische Anwendungsfälle:

- Algorithmen

- Omnichannel-Experiences

- Dynamische Inhalte aus externen Quellen

- Anpassungen der Datenbank-Performance

Zudem ermöglicht serverseitiges Testing, Einschränkungen durch Tracking-Technologien wie ITP zu umgehen.

A/B-Testing im Unternehmen etablieren

Die Einführung von A/B-Testing erfordert einen Top-down-Ansatz und strategische Verankerung im Unternehmen. Der Aufwand lohnt sich: Unternehmen mit starken Wachstumszielen investieren zunehmend in verschiedene Experimentation-Methoden, darunter A/B-Testing.

Für den erfolgreichen Start eines Experimentation-Programms sind drei zentrale Aspekte zu berücksichtigen:

1. Eine Experimentation-Kultur aufbauen

Eine der wichtigsten Voraussetzungen für erfolgreiches A/B-Testing ist der Aufbau einer Experimentation-Kultur im Unternehmen. Eine teamübergreifende Ausrichtung auf datenbasierte Entscheidungen und verantwortungsvollen Umgang mit Daten bildet die Grundlage für optimierte und personalisierte Experiences.

Neben internen Expert:innen können auch externe Spezialist:innen wertvolle Impulse für den Aufbau eines Testing-Programms liefern.

Eine etablierte Experimentation-Kultur ist entscheidend, um A/B-Testing nachhaltig und wirkungsvoll einzusetzen.

2. Die richtigen Rollen und Kompetenzen aufbauen

Ein starkes CRO-Team ist entscheidend für den Erfolg eines Experimentation-Programms. Wichtige Rollen sind:

Personalisierungsspezialist:innen und Projektmanager:innen: Sie strukturieren die Strategie und koordinieren die Umsetzung über verschiedene Teams und Ressourcen hinweg.

Developer: Verantwortlich für Integration und technische Umsetzung der Experimente.

Designer mit UX-Expertise: Gestalten Experiences und Interfaces, die auf die Bedürfnisse von Besucher:innen abgestimmt sind.

3. Unterschiedliche A/B-Testing-Programme aufsetzen

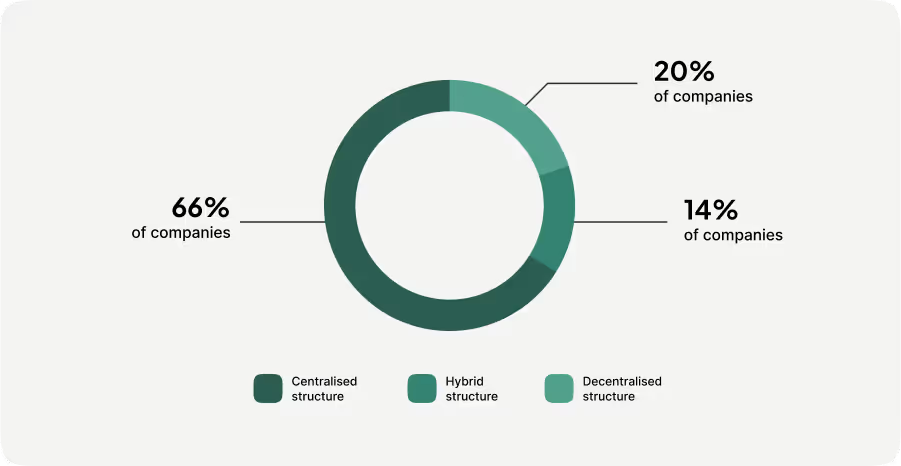

Für den Aufbau eines dedizierten Experimentation-Teams können drei etablierte Organisationsmodelle als Orientierung dienen:

- Zentralisierte Struktur: Eine zentrale Einheit definiert die Testing-Strategie und priorisiert Experimente entsprechend den Anforderungen der einzelnen Teams.

- Dezentrale Struktur: Expert:innen sind in den jeweiligen Teams verankert und ermöglichen die parallele Durchführung mehrerer Projekte.

- Hybride Struktur: Kombination aus zentraler Steuerung und dezentraler Umsetzung durch spezialisierte Expert:innen.

Wie ein A/B-Testing-Programm aufgebaut wird

Unternehmen jeder Größe und mit unterschiedlichen Ressourcen können aussagekräftige A/B-Tests durchführen – vorausgesetzt, sie folgen einem strukturierten Vorgehen.

Die folgenden sieben Schritte bilden die Grundlage für eine erfolgreiche Testing-Strategie:

Schritt 1: Management Commitment sichern

Die Unterstützung durch die Unternehmensleitung ist ein entscheidender Erfolgsfaktor für ein nachhaltiges A/B-Testing-Programm. Sie erhöht die Wahrscheinlichkeit, dass Ressourcen langfristig bereitgestellt werden.

Zu Beginn sollte geklärt werden, welche KPIs für die strategischen Ziele relevant sind und im Fokus stehen.

Bei Skepsis im Management kann es sinnvoll sein, Hypothesen gemeinsam zu definieren und die Ergebnisse transparent zu präsentieren. Auch erste Tests liefern – unabhängig vom Ausgang – wertvolle Erkenntnisse und schaffen Vertrauen.

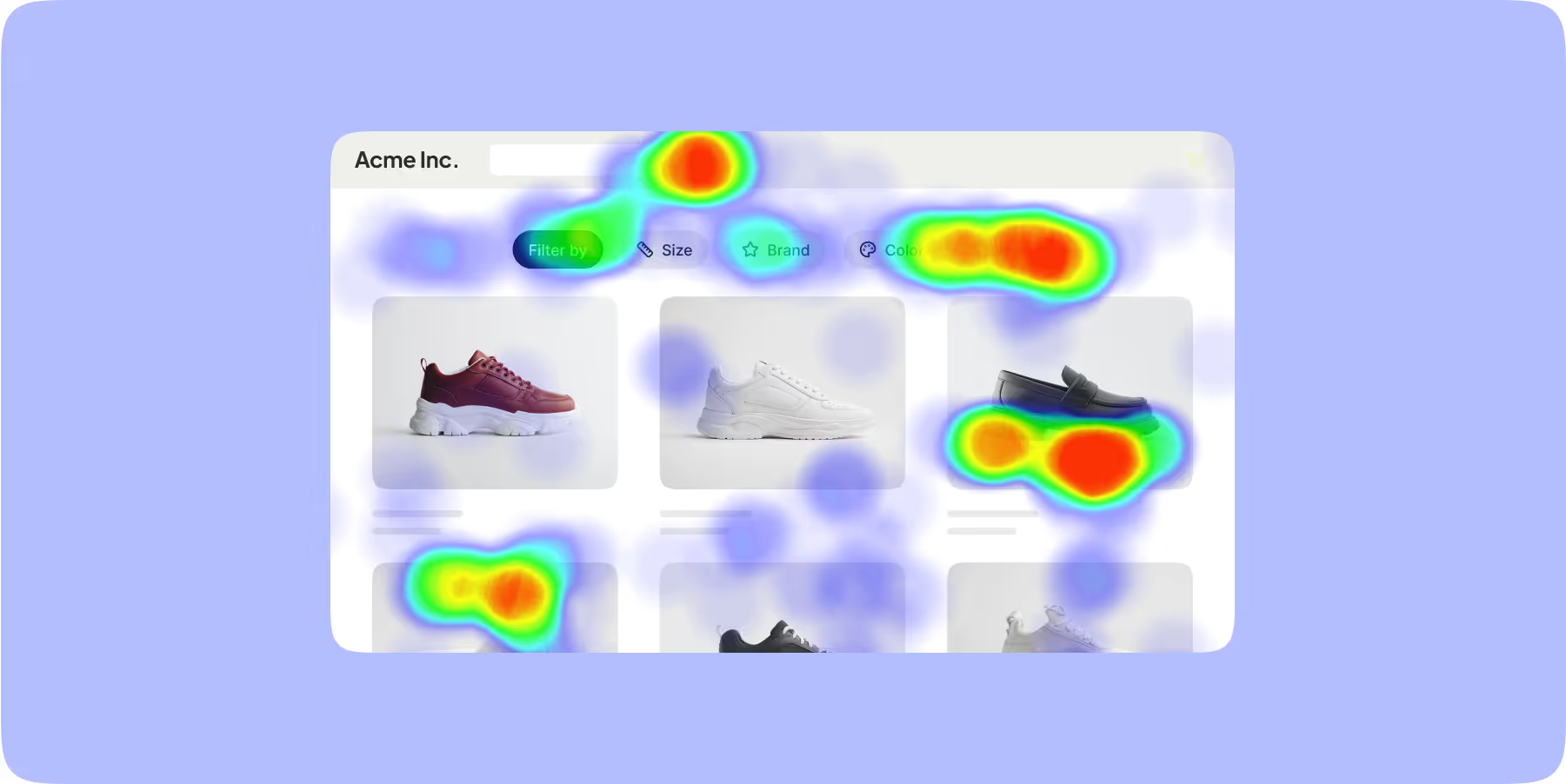

Schritt 2: Website-Performance messen und analysieren

Im nächsten Schritt gilt es zu identifizieren, wo Optimierungspotenziale bestehen. Da jede Website unterschiedlich ist, sollte die Strategie auf Basis von Nutzerverhalten, definierten Zielen und bestehenden Performance-Daten entwickelt werden.

Zur Identifikation von Reibungspunkten können Behavioral-Analytics-Tools wie Click-Tracking oder Heatmaps eingesetzt werden.

Schritt 3: Hypothesen formulieren

Sobald die Reibungspunkte identifiziert sind, die Conversions verhindern, können daraus Hypothesen für A/B-Tests abgeleitet werden.

Eine Hypothese ist eine fundierte Annahme über das Verhalten von Kund:innen. Aussagekräftige A/B-Tests basieren auf evidenzbasierten Hypothesen.

So lässt sich aus einer Hypothese ein Experiment entwickeln:

- Beobachtung: Die installierte Sticky Bar wird von Besucher:innen nur selten genutzt.

- Hypothese: Die Icons sind nicht eindeutig genug. Zusätzlicher Kontext könnte diese Schwachstelle reduzieren.

- Geplantes Experiment: Ergänzung von Text unterhalb jedes Icons.

Schritt 4: A/B-Tests priorisieren und eine Testing-Roadmap definieren

Eine klare Priorisierung ist entscheidend, um eine effektive A/B-Testing-Roadmap aufzubauen und belastbare Ergebnisse zu erzielen.

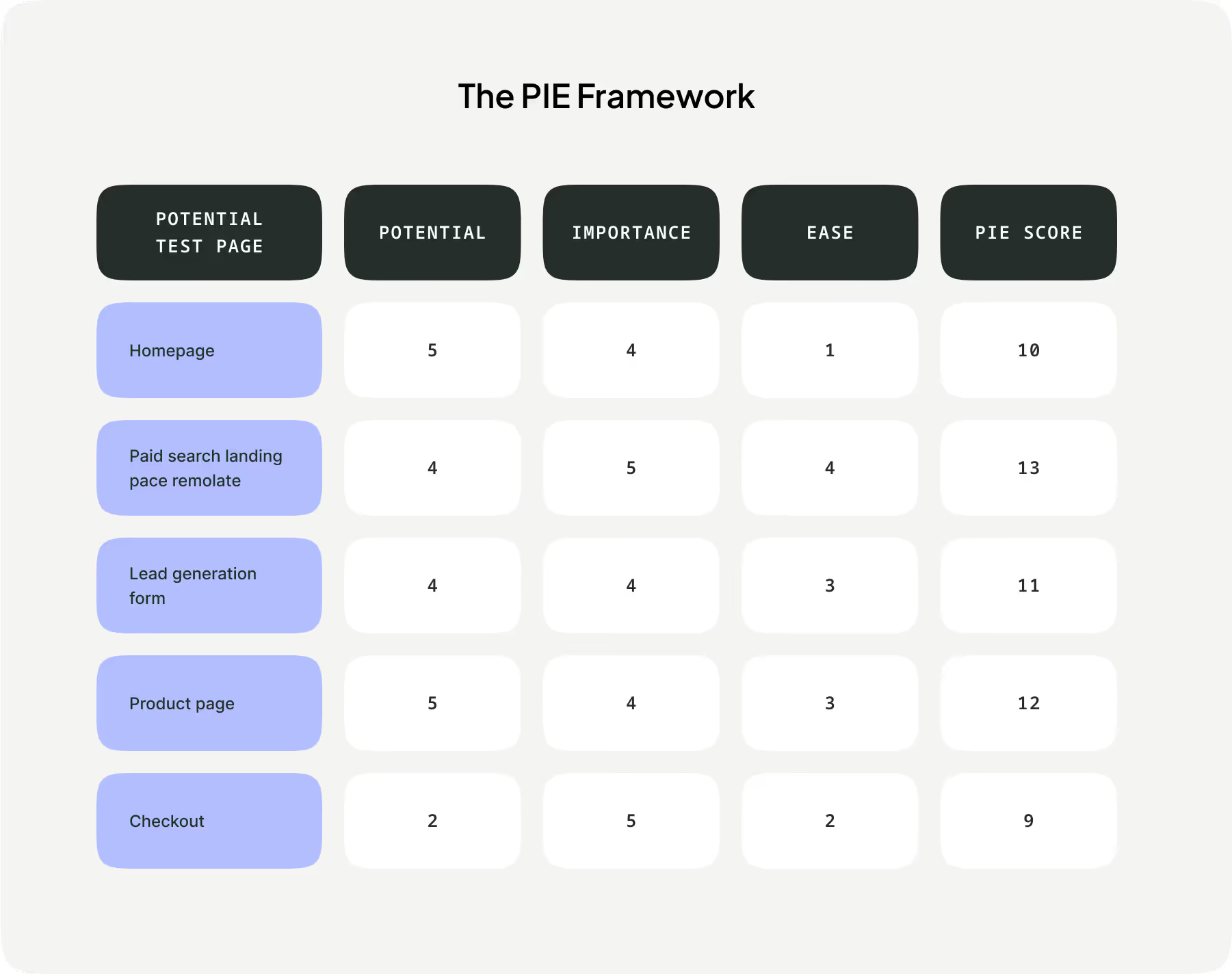

Das PIE-Framework von WiderFunnel unterstützt bei der Bewertung von Testideen anhand von drei Kriterien (jeweils auf einer Skala von 1 bis 10):

- Potential: Wie groß ist das Optimierungspotenzial dieser Seite?

- Importance: Wie relevant ist der Traffic (Volumen und Qualität)?

- Ease: Wie einfach lässt sich der Test umsetzen (10 = sehr einfach, 1 = sehr komplex)?

Die Priorisierung der Tests erfolgt durch die Summe der drei Bewertungen.

Schritt 5: Test durchführen

Nach der Vorbereitung beginnt die eigentliche Testphase. Wichtig ist, laufende Tests nicht zu verändern, sondern vollständig durchlaufen zu lassen, um valide Ergebnisse zu erhalten.

Schritt 6: Ergebnisse analysieren

Die Auswertung der Testergebnisse ist zentral, um fundierte Entscheidungen zu treffen. A/B-Testing dient dazu, aus Experimenten zu lernen und datenbasierte Maßnahmen abzuleiten.

Für eine effektive Analyse:

- Falsch-positive Ergebnisse erkennen

- Repräsentative Nutzersegmente definieren

- Nicht zu viele Varianten gleichzeitig testen

- Testideen nicht nach einem einzelnen Fehlschlag verwerfen

Schritt 7: Wiederholen

Nach der Analyse der Ergebnisse gilt es, die gewonnenen Erkenntnisse in neue Hypothesen zu überführen und weitere Tests abzuleiten.

A/B-Testing und Experimentation basieren auf kontinuierlichen Feedback-Loops: Erkenntnisse führen zu neuen Erkenntnissen, Optimierungen zu weiteren Verbesserungen.

Nach Abschluss einer Testreihe sollte unmittelbar die nächste gestartet werden, um Fortschritte nachhaltig zu sichern.

Tipps zur Optimierung eines A/B-Testing-Programms

Ein zentraler Hebel zur Verbesserung eines bestehenden Experimentation-Programms ist die Segmentierung der Zielgruppe. Tests über die gesamte Nutzerbasis hinweg liefern oft nur Durchschnittswerte und bilden keine realen Verhaltensmuster ab.

Durch die Aufteilung in sinnvolle Segmente lässt sich die Aussagekraft der Ergebnisse deutlich erhöhen.

Mögliche Segmentierungsansätze:

- Demografische Merkmale

- Geografische Faktoren

- Neue vs. wiederkehrende Besucher:innen

- Mobile vs. Desktop-Nutzung

Jedes Segment weist unterschiedliche Bedürfnisse und Verhaltensmuster auf. Eine gezielte Ansprache ermöglicht tiefere Insights und fundiertere Optimierungen.

Einfach starten

Zu Beginn sollte auf eine zu feingranulare Segmentierung verzichtet werden. Sinnvolle, übergeordnete Segmente – wie neue vs. wiederkehrende Besucher:innen – bieten eine solide Grundlage für erste Tests.

Segmente schrittweise verfeinern

Experimentation ist ein iterativer Prozess. Sobald belastbare Ergebnisse auf höherer Ebene vorliegen, kann die Segmentierung schrittweise verfeinert werden, um tiefere Insights zu gewinnen.

Aktuelle Daten priorisieren

Für valide Ergebnisse ist die Aktualität der Daten entscheidend. Nutzerverhalten verändert sich schnell, daher sollten Segmente möglichst auf aktuellen Interaktionen basieren und vergleichbare Zeiträume berücksichtigen.

Häufige Fehler im A/B-Testing und wie sie vermieden werden können

A/B-Testing bietet erheblichen Mehrwert und ist vergleichsweise einfach umzusetzen. Dennoch treten insbesondere zu Beginn häufig typische Fehler auf.

Im Folgenden werden zentrale Herausforderungen dargestellt – sowie Ansätze, um diese gezielt zu vermeiden.

Mangelnde Vorbereitung

Auch erste A/B-Tests sollten auf einer fundierten Analyse basieren. Ohne Verständnis für das Nutzerverhalten und ohne Datenbasis fehlt die Grundlage für belastbare Ergebnisse.

Bereits einfache Kennzahlen wie Conversion Rates, Seitenaufrufe oder Unique Visitors liefern wertvolle Orientierung. Tests sollten stets datenbasiert und nicht ausschließlich intuitiv entwickelt werden.

Zu kleine Stichproben

Eine zu geringe Teilnehmerzahl führt zu nicht aussagekräftigen Ergebnissen. Ohne ausreichende Datenbasis lassen sich keine statistisch validen Erkenntnisse ableiten.

Die erforderliche Stichprobengröße hängt unter anderem ab von:

- Gesamtanzahl der Website-Besucher:innen

- Aktuelle Conversion Rate

- Erwarteter Minimaler Effekt (Minimum Detectable Effect, MDE)

Änderungen während des Tests

Anpassungen während eines laufenden A/B-Tests beeinträchtigen die Validität der Ergebnisse. Sobald sich die Testbedingungen ändern, sind die Varianten nicht mehr vergleichbar.

Stattdessen sollte der Test unverändert abgeschlossen, die Ergebnisse analysiert und die Erkenntnisse im nächsten Experiment berücksichtigt werden.

Sample Ratio Mismatch (SRM) nicht prüfen

Ein Sample Ratio Mismatch liegt vor, wenn Varianten ungleichmäßig Traffic erhalten.

Eine solche Verzerrung führt zu nicht belastbaren Ergebnissen. Daher sollte überprüft werden, ob die Verteilung korrekt ist – etwa mithilfe statistischer Verfahren wie dem Goodness-of-Fit-Test oder spezialisierter Tools.

Intelligent Tracking Prevention (ITP) nicht berücksichtigen

Apple’s Intelligent Tracking Prevention (ITP) begrenzt die Speicherung von First- und Third-Party-Cookies auf sieben Tage – unabhängig von den ursprünglich gesetzten Laufzeiten, etwa in Google Analytics.

Das führt dazu, dass wiederkehrende Nutzer:innen nach Ablauf dieses Zeitraums als neue Besucher:innen gezählt werden. Ohne Berücksichtigung von ITP werden zentrale Kennzahlen wie neue Besucher:innen, Unique Visitors oder Time-to-Buy verzerrt.

Abhilfe schaffen Lösungen, die beispielsweise Local Storage nutzen, um diese Einschränkungen zu umgehen und eine konsistentere Datengrundlage zu gewährleisten.

Fehlerhafte Analyse von Testergebnissen

Der Erfolg eines A/B-Tests hängt nicht allein vom Ergebnis ab, sondern von der Qualität der Analyse. Ohne eine fundierte Auswertung bleibt das Potenzial zur Optimierung ungenutzt.

Jedes statistisch signifikante Ergebnis liefert wertvolle Erkenntnisse – unabhängig davon, ob die getestete Variante besser performt hat oder nicht.

Entscheidend ist das Verständnis, warum ein Test erfolgreich oder nicht erfolgreich war. Nur so lässt sich die Customer Experience gezielt weiterentwickeln.

Fehlende Experimentation-Kultur

Ein erfolgreiches Experimentation-Programm lässt sich nicht von einzelnen Personen tragen. Es erfordert Unterstützung auf allen Ebenen – sowohl Top-down als auch Bottom-up.

Marketing-, Produkt-, Design- und IT-Teams müssen gemeinsam auf ein Ziel hinarbeiten. Auch wenn einzelne Initiativen den Start ermöglichen, entfaltet Experimentation ihren Wert erst über Zeit.

Eine nachhaltige Wirkung entsteht nur durch den Aufbau einer unternehmensweiten Experimentation-Kultur.

Worauf bei einer A/B-Testing-Plattform zu achten ist

Bei der Auswahl einer A/B-Testing-Plattform sollte der Fokus darauf liegen, wie gut sie den gesamten Testing-Prozess unterstützt. Einzelne technische Features sind wichtig, entscheidend ist jedoch eine prozessorientierte Lösung.

Zur Bewertung empfiehlt es sich, Funktionen entlang der einzelnen Phasen des Testing-Prozesses zu betrachten. Eine geeignete Plattform adressiert möglichst viele der spezifischen Anforderungen und Herausforderungen innerhalb des Teams.

Zieldefinition

Vor der Umsetzung konkreter Tests ist es entscheidend, die Unterstützung des Managements sicherzustellen und klare Ziele für das A/B-Testing-Programm zu definieren. Nur so kann gewährleistet werden, dass Tests die richtigen Zielgruppen adressieren.

Im Fokus steht die Frage, welche Experience optimiert werden soll. Beispielsweise können unterschiedliche Call-to-Actions auf einer Landingpage getestet werden. Dafür müssen passende KPIs definiert werden, etwa die Anzahl der Klicks oder das Engagement.

Wichtige A/B-Testing Plattform-Features:

- Breite Auswahl an messbaren KPIs, z. B. Klicks, Scroll-Tiefe, Seitenaufrufe, Retention Rate oder Verweildauer

- Möglichkeit zur Definition individueller Ziele, etwa für E-Commerce-Transaktionen mit spezifischen Attributen wie Transaktions-ID, Bestellwert oder Zahlungsart

Erweiterte Zielgruppensegmentierung

Für qualitativ hochwertige A/B-Tests ist ein tiefes Verständnis der Zielgruppe erforderlich. Tests über die gesamte Nutzerbasis hinweg liefern häufig nur wenig aussagekräftige Durchschnittswerte.

Daher ist es entscheidend, Besucher:innen vor der Durchführung von Tests gezielt zu segmentieren.

Wichtige A/B-Testing Plattform-Features:

- Erfassung von Besucherdaten in Echtzeit

- Targeting-Engine zur Segmentierung nach verhaltensbasierten, technischen oder kontextuellen Kriterien

- Segmentierung nach Datenquelle (z. B. Landingpage, Referrer oder Traffic-Typ)

- Segmentierung nach digitalen Merkmalen (z. B. Sprache, Gerät, IP-Adresse, Bildschirmauflösung oder Browser-Version)

- Segmentierung nach Verhalten (z. B. neue vs. wiederkehrende Besucher:innen oder Kundentypen)

- Segmentierung nach Zeit oder externen Faktoren

- Integration externer Datenquellen über Schnittstellen

- DSGVO-konforme Segmentierung

Trigger und Umsetzung von Experimenten

A/B-Tests werden durch spezifische Nutzerinteraktionen oder Browser-Events ausgelöst – sogenannte Trigger. Eine geeignete Experimentation-Lösung sollte diese Trigger flexibel definieren und auf Basis des Nutzerverhaltens aktivieren können.

Wichtige Plattform-Features für Trigger:

- Seitenbasierte Trigger (z. B. Seitenaufrufe, Verweildauer, vorhandene Elemente)

- Generische Trigger (z. B. Mouse-Out-Events oder API-basierte Ereignisse)

Einfache Erstellung von Testvarianten

Nach Zieldefinition, Segmentierung und Trigger-Setup folgt die Umsetzung des Experiments. Dabei werden Varianten erstellt, konfiguriert und ausgerollt.

Die Plattform sollte eine intuitive Erstellung und Anpassung von Elementen ermöglichen.

Wichtige A/B-Testing Plattform-Features:

- Visueller Editor zur Erstellung individueller Elemente

- WYSIWYG-Overlay zur Bearbeitung direkt auf der Seite

- Möglichkeit, Seiten aus Nutzerperspektive zu prüfen

- Automatische Erkennung von Elementtypen (z. B. Bild, Button, Formular)

- Kontextabhängige Bearbeitungsoptionen je Elementtyp

- Entwickler-Interface für CSS und JavaScript

- Widget-Bibliothek

- Simulationstool zur Überprüfung von Varianten, Targeting, KPIs und Konflikten

- Integrationen mit zentralen MarTech-Systemen (z. B. Analytics, CDP/DMP, Automation, Consent, CMS, E-Mail)

Erweiterte Testentwicklung und -verwaltung

A/B-Tests können von einfachen Anpassungen – etwa der Farbe von Call-to-Actions – bis hin zu komplexen Experimenten entlang des gesamten Conversion Funnels reichen.

Eine leistungsfähige Experimentation-Plattform sollte auch erweiterte Funktionen unterstützen, beispielsweise die dynamische Steuerung der Traffic-Verteilung, um Verzerrungen wie Sample Ratio Mismatches zu vermeiden.

Für technisch anspruchsvolle oder skalierbare Projekte ist zudem eine enge Integration mit Entwicklungsressourcen erforderlich.

Server-side Testing spielt für viele Teams eine zentrale Rolle, da Experimente direkt in der Backend-Infrastruktur durchgeführt werden können – eine Funktion, die nicht alle Lösungen bieten.

Wichtige A/B-Testing Plattform-Features:

Für fortgeschrittene Experimentation sind folgende Features besonders relevant:

- Verwaltung von Multivariate Testing

- Unterstützung für Multi-Site- und Multi-Domain-Setups

- Individuell definierbare Attribution Windows zur präzisen Zuordnung von Conversions

- Steuerung von Traffic-Allokationsalgorithmen (z. B. linear oder Multi-Armed Bandit)

- Planung und Terminierung von Tests

- Feature Flagging zur regelbasierten Aussteuerung von Features

- Schätzung der Testlaufzeit

- Server-side Testmanagement

- Logic Caching zur Performance-Optimierung

- Full-Stack-Entwicklungstools (REST API, SDKs, Developer Portal)

- Automatisiertes Application Management

- SDK- und API-Bibliotheken

Vereinfachtes Problemmanagement

Auch bei sorgfältiger Planung verlaufen Experimente nicht immer reibungslos. Entscheidend ist daher, über geeignete Mechanismen zur schnellen Identifikation und Behebung von Problemen zu verfügen.

Fehlerhafte Tests können sich negativ auf die Performance einer gesamten Website auswirken. Eine stabile und optimierte Architektur der Experimentation-Plattform reduziert dieses Risiko erheblich.

Wichtige A/B-Testing Plattform-Features:

- Vermeidung von Flicker-Effekten

- Berücksichtigung von ITP für zuverlässiges Testing trotz eingeschränkter Cookie-Laufzeiten

- Automatisches Consent-Management zur Einhaltung von Datenschutzanforderungen

Einfach auswertbare Ergebnisse

Nach der Datenerhebung beginnt der entscheidende Schritt: die Analyse der Ergebnisse.

Ziel ist es, auf Basis der Daten fundierte Entscheidungen zu treffen, Optimierungen abzuleiten und die Conversion-Optimierungs-Roadmap kontinuierlich weiterzuentwickeln. Dafür sind verständliche und flexibel anpassbare Reporting-Tools unerlässlich.

Wichtige A/B-Testing Plattform-Features:

- Reporting mit relevanten KPIs, z. B. Conversion-Uplift und statistische Genauigkeit

- Verschiedene statistische Analysemodelle (frequentistisch oder bayesianisch)

- Flexible Auswertungsoptionen (z. B. nach Besucher:innen, Visits oder Conversions)

- Datenvisualisierung mit interaktiven Grafiken und Zeitverläufen

- Individuell anpassbare Reports

- Filtermöglichkeiten nach Testkriterien

- Vergleichsansichten über verschiedene Zeiträume

- Sharing-Funktionen (Export oder URL-Sharing)

- Alerts basierend auf individuellen Business-Kriterien

- Entscheidungsunterstützende Systeme

- Integration externer Analyse-Tools

Support entlang des gesamten Testing-Prozesses

Experimentation sollte nicht isoliert erfolgen. Neben interner Abstimmung sind auch passende Tools und Services entscheidend für den Erfolg. Der Support durch den Anbieter der A/B-Testing-Plattform spielt dabei eine zentrale Rolle.

Die Anforderungen an Support unterscheiden sich je nach Reifegrad des Unternehmens und des Testing-Programms. Daher ist es wichtig, eine Lösung zu wählen, die flexibel auf unterschiedliche Bedürfnisse eingehen kann.

Wichtige A/B-Testing Plattform-Features:

- Self-Service-Angebote wie Tutorials und dauerhafter Zugang zum Helpdesk

- Dedizierte Customer Success Manager:innen für strategische Unterstützung

- Technische Ansprechpartner:innen für komplexe Projekte

- Möglichkeit zur Zusammenarbeit mit Agenturpartnern

Datenschutzkonformes A/B-Testing

Viele Branchen unterliegen strengen Datenschutzvorgaben. Auch in Bereichen wie Finanzwesen, Gesundheitswesen oder Bildung ist A/B-Testing möglich – erfordert jedoch zusätzliche Vorbereitung.

Das gilt ebenso für Unternehmen, die unter Regularien wie der DSGVO oder dem CCPA arbeiten.

Trotz dieser Rahmenbedingungen können und sollten digitale Services kontinuierlich optimiert werden. Wichtige Aspekte:

- Jede Form von Experimentation ist wertvoller als keine

- Eine Experimentation-Kultur ist in regulierten Branchen besonders relevant

- A/B-Testing kann ohne personenbezogene Daten (PII) durchgeführt werden

- Einsatz von Tools, die für den Umgang mit sensiblen Daten konzipiert sind

Regulatorische Anforderungen führen häufig zu vorsichtigeren Entscheidungen. Entscheidend ist, vertretbare Risiken zu identifizieren und gezielt für die Optimierung der Customer Experience zu nutzen.

Mit A/B-Testing starten

Eine Strategie, die auf A/B-Testing und fundierter Datenanalyse basiert, stärkt die Wettbewerbsfähigkeit und Agilität eines Unternehmens. Gleichzeitig entsteht eine verlässliche Grundlage, um das Verhalten und die Erwartungen von Kund:innen besser zu verstehen.

Der Einsatz einer A/B-Testing-Plattform liefert tiefere Einblicke in die Customer Journey und ermöglicht messbare Verbesserungen, wie reduzierte Absprungraten und steigende Conversion Rates.

FAQ

In der Regel testen Sie zwei Versionen: Ihre ursprüngliche Version, die A-Version – auch Kontrollversion genannt – gegen die modifizierte B-Version, von der Sie annehmen, dass sie besser funktioniert. Bevor Sie Ihren A/B-Test erstellen, entscheiden Sie, welche Kennzahlen Sie messen möchten, damit Sie quantifizieren können, was „besser“ in Ihren Testergebnissen bedeutet.

Bei einem A/B-Test werden den Nutzern mehrere Versionen einer Webseite oder einer App präsentiert, um festzustellen, welche Version zu besseren Ergebnissen führt. A/B-Tests sind eine relativ einfache Methode, um die Nutzerbindung zu verbessern, ansprechendere Inhalte anzubieten, die Absprungrate zu senken und die Conversion Rate zu erhöhen.Jedes Mal, wenn Sie einen A/B-Test durchführen, erfahren Sie mehr darüber, wie Ihre Kunden mit Ihrer Website oder App umgehen. Mit der Zeit schafft ein umfassendes Testprogramm eine Feedbackschleife, die Ihre Inhalte immer effektiver macht und eine Grundlage für neue, noch aufschlussreichere Tests bietet.

A/B-Tests können so einfach oder so komplex sein, wie Sie wollen. Sie können zum Beispiel einfache Versionstests durchführen, bei denen Sie die Wirksamkeit einer neuen B-Version mit einer ursprünglichen A-Version vergleichen. Sie können auch multivariate Tests (MVT) durchführen, bei denen Sie die Wirksamkeit verschiedener Kombinationen von Änderungen vergleichen. Sie können auch drei oder mehr Varianten gleichzeitig testen, was als A/B/n-Test bezeichnet wird.

A/B-Tests sind eine unglaublich vielseitige Methode, um Erkenntnisse über die Websitebesucher zu gewinnen. Sie kann für viele Teams wertvoll sein, darunter Marketing-, Produkt- und Growthteams. Marketingteams können A/B-Tests erstellen, um herauszufinden, welche Kampagnen Kunden effektiv in den Trichter führen. Produktteams können die Benutzerbindung und das Engagement testen. Growthteams können mit A/B-Tests ganz einfach verschiedene Komponenten der Customer Journey bewerten.